Evolução do deep fake desperta temor em empresas e políticos

Tecnologia de edição de vídeo manipula a realidade, deixando qualquer um em dúvida. Com ela, é possível alterar discursos e posicionamentos que podem custar uma carreira, eleição e até sua vida pessoal

Imagine a cena: você recebe um vídeo de um candidato falando as maiores atrocidades do mundo. O vídeo é bem realista. Como não ser ele? Mas, depois de algumas horas, o vídeo é desmascarado por técnicos. Era uma montagem. Agora, pense no impacto que esta produção falsa pode ter na carreira de um profissional ou nas eleições? Na velocidade atual das redes sociais e do WhatsApp, mesmo com todo o desmentido, a popularidade do indivíduo em questão pode ter sido destruída. Isso é deep fake. A tecnologia existe e está evoluindo.

Abaixo dois exemplos de Deep Fake. A primeira, perfeita, traz um vídeo de Barack Obama, ex-presidente dos EUA. Confira:

A segunda é tom de brincadeira com uma mesa redonda envolvendo astros de Hollywood, entre eles até "George Lucas", criador de Star Wars. Veja:

De acordo com o professor do Instituto Federal de Educação, Ciência e Tecnologia do Ceará (IFCE), Amauri Holanda, enquanto atualmente a maioria das manipulações pode ser facilmente detectada por usuários mais atentos, o aperfeiçoamento do deep fake pode apresentar diversos riscos à sociedade.

“Deep fake pode ser usado para minar a reputação de figuras públicas, destruir relacionamentos amorosos e gerar falsos alertas de emergência. Além disso, pode ainda sofisticar crimes já existentes, como o uso de vozes falsas para extorsão, conhecido também como falso sequestro”, disse.

O início

No começo, eram apenas memes ou o uso de rostos de atrizes ou atores em filmes pornográficos. Hoje, já há técnicas de deep fake disponíveis em fóruns que dão o passo a passo e alguns códigos para quem quiser se aventurar.

Logicamente, é preciso ter conhecimento em programação e computadores potentes. Porém, se soluções em desenvolvimento nos EUA, por universidades em conjunto com a Adobe forem lançadas, aí tudo muda de patamar. Por alguns dólares e um treinamento – e ainda PCs potentes – já é possível ter acesso ao deep fake. A Adobe mostrou em 2016 o VoCo, um software que edita áudios de forma perfeita, o qual poderia ajudar a manipular gravações. Porém, ainda não saiu para produção.

Apesar dos perigos, a tecnologia foi pensada e desenvolvida para ajudar. O programa que modifica vídeos servirá (se for lançado) para editores de imagens terem menos trabalho na correção de textos em áudios nos vídeos, de forma que gere menos horas de esforço, economizando dinheiro. O problema é que também pode ser usado para o mal.

Técnicas de Inteligência Artificial (IA), Deep Learning, programação (como a linguagem Python) e Machine Learning, junto a um computador com hardware robusto serão usadas para a criação de deep fake de qualidade. Mas com o desenvolvimento de softwares tudo isso pode mudar e o conhecimento de linguagem de programação e das demais técnicas cairá. A chamada “fórmula de bolo”, tão usual para hackers novatos, deverá causar uma revolução.

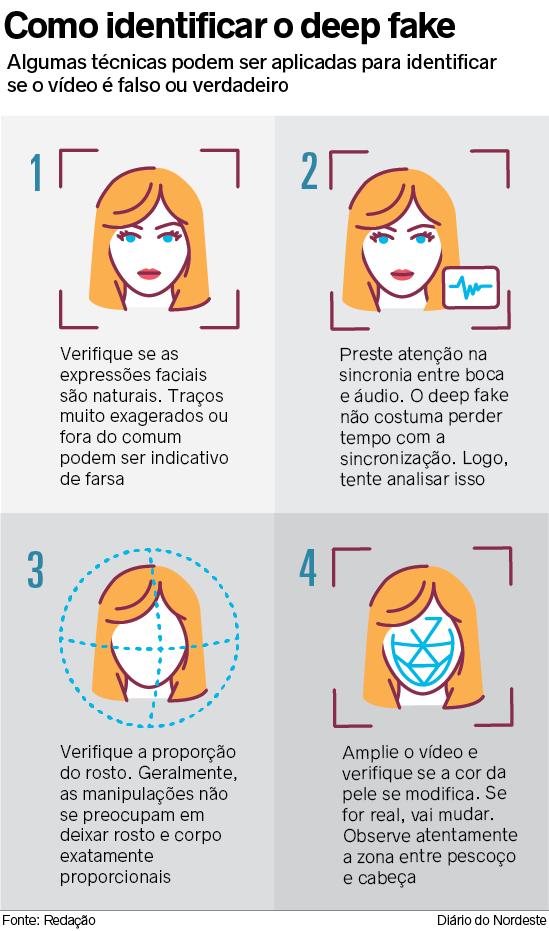

Segundo Marcos Monteiro, presidente da Associação Nacional de Peritos em Computação Forense (Apecof), há técnicas em computação forense de imagem que permitem comparar um frame de um vídeo com o frame anterior e, a depender de como o deep fake foi construído, nos casos em que foi muito mal feito, identificar pequenos vestígios.

A dificuldade, de acordo com ele, leva grandes empresas a “patrocinarem” a descoberta de técnicas de combate. “O Facebook, em setembro, ofereceu US$ 10 milhões para quem criasse um detector de deep fake”.

Combate

Além disso, Monteiro revela que, em novembro último, um algoritmo desenvolvido por pesquisadores das universidade da Califórnia, de Berkeley e da Universidade Southern Califórnia, identificou características como o movimento da cabeça, testas e narizes franzidos ou a pressão sobre os lábios que podem acusar o deep fake. “Porém, se o vídeo tiver baixa resolução, a análise pode ser inconclusiva. Alguns pesquisadores apontam que em seis meses ficará impossível identificar um vídeo manipulado com uso de técnicas computacionais tradicionais”.

No blog do Google a empresa mostra que considera o deep fake seriamente. Eles publicaram que estão comprometidos em desenvolver as melhores práticas de Inteligência Artificial para reduzir o potencial de danos e abusos. “Em janeiro passado, anunciamos o lançamento de um conjunto de dados de fala sintética para apoiar um desafio internacional de desenvolver detectores de áudio falsos de alto desempenho. O conjunto de dados foi baixado por mais de 150 organizações de pesquisa e indústria como parte do desafio e agora está disponível grátis ao público”.

Agora, em colaboração com a Jigsaw, o Google anunciou o lançamento de um grande conjunto de dados de deep fakes visuais que foram incorporados à Universidade Técnica de Munique (ALE) e ao novo benchmark FaceForensics da Universidade Federico II de Nápoles (ITA), um esforço do Google com copatrocinadores. “A incorporação desses dados no benchmark de vídeo do FaceForensics está em parceria com os principais pesquisadores. Você pode baixar os dados na página do github do FaceForensics (bit.ly/2LzhbHi)”, finaliza a empresa, mostrando preocupação em criar contramedidas ao avanço da deep fake.

Risco é grande com manipulação

Segundo o professor adjunto do Departamento de Computação da Universidade Federal do Ceará (UFC), João Paulo Gomes, atualmente, uma das vertentes mais ativas na área de Inteligência Artificial é a do projeto de sistemas capazes de gerar dados (áudio, imagens e vídeos). "São os chamados modelos generativos. O interesse por esse tipo de modelo tem crescido devido à grande disponibilidade de dados atuais (através da internet) e à alta capacidade de processamento a baixo custo, por conta das placas de vídeo modernas. Desta forma, é natural e esperado que a capacidade de tais modelos evolua muito rapidamente, atingindo níveis onde a distinção entre real e simulado seja muito difícil para seres humanos". Está aí uma das grandes dificuldades do combate ao deep fake e um dos maiores temores de especialistas é que esta tecnologia se propague atingindo todos os níveis da nossa sociedade atual, interferindo em decisões importantes e não só em relacionamentos ou carreiras de forma individual. Há riscos já para as próximas eleições de manipulação envolvendo esta nova tecnologia ou tudo é muito novo para temermos uma onda de vídeos falsos com tanta qualidade que nos farão mudar a opinião sobre alguém ou um algum tipo de projeto?

Mais do mesmo?

Para Marcos Monteiro, presidente da Associação Nacional de Peritos em Computação Forense (Apecof), o risco do uso de técnicas de deep fake nas eleições já de 2020 é possível, mas, pelo menos, nas duas últimas eleições presidenciais, ações ainda mais simples lotaram de fake news o processo. "Não precisamos olhar pra frente. A internet, já há duas eleições, foi a principal ferramenta para disseminação de fake news com o objetivo de manipular a massa, tanto a disseminação de notícias falsas ou até mesmo a divulgação de notícias verdadeiras fora de contexto ou de época".

O que fazer?

Na visão do professor Amauri Holanda, do IFCE, é necessário um esforço conjunto de governos e de empresas de tecnologia. "Parcerias entre universidades e empresas de tecnologia são importantes no desenvolvimento de novas estratégias para mitigar os efeitos e detectar essas manipulações". Ele cita ações já em caminho por parte do Facebook para detectar e remover conteúdo falso em suas plataformas. "Iniciativas como essas devem ser seguidas por outras gigantes da área de tecnologia. O desenvolvimento de protocolos e certificados de autenticidade podem ser um caminho para gerar um rastro de informação confiável", garante.

Limites?

Sobre limites para a tecnologia, ou seja, controles para evitar sua evolução ou disseminação para todos, o professor João Paulo não acredita que seja possível ou mesmo benéfico para a sociedade impor limites ao desenvolvimento tecnológico. "A punição deve acontecer se alguém faz mau uso da tecnologia", afirma. O professor Amauri também reforça que não devemos trabalhar com a ideia de proibição ou censura do uso de IA. "A mesma tecnologia utilizada para gerar imagens falsas é também usada na descoberta de novos medicamentos. Portanto, eu defendo que o combate ao deep fake seja realizado principalmente na esfera tecnológica. Isso não significa que eu não defenda também políticas de controle e fiscalização de aplicativos criados com o propósito de gerar conteúdo falso ou ainda a responsabilização de pessoas que os usem de forma a causar danos à sociedade", encerra.

Imagine Cup 2020

As inscrições para a edição 2020 da Imagine Cup estão abertas. A Imagine Cup está à procura de soluções tecnológicas inovadoras e movidas pela paixão de estudantes que desejam compartilhar seu propósito de melhorar o mundo ao nosso redor. O prazo final para se inscrever é 15 de janeiro de 2020

Adiou outra vez

Um novo pedido de vistas sobre o edital que vai decidir os rumos do leilão do 5G no Brasil empurrou para 2020 a decisão e, consequentemente, o tão esperado leilão, que anteriormente seria no 2º semestre de 2020, agora pode acontecer só em 2021. Assim, podemos ter acesso à tecnologia só em 2022

-min.jpg?f=4x3&h=216&w=288&$p$f$h$w=4e40e99)

.jpeg?f=4x3&h=216&w=288&$p$f$h$w=a7cc3cd)